Rangka Pantas

Siaran ini akan menunjukkan:

Cara Melaksanakan Logik ReAct Dengan Stor Dokumen dalam LangChain

- Memasang Rangka Kerja

- Menyediakan Kunci API OpenAI

- Mengimport Perpustakaan

- Menggunakan Wikipedia Explorer

- Menguji Model

Bagaimana untuk Melaksanakan Logik ReAct Dengan Stor Dokumen dalam LangChain?

Model bahasa dilatih pada kumpulan besar data yang ditulis dalam bahasa semula jadi seperti bahasa Inggeris, dll. Data diurus dan disimpan dalam stor dokumen dan pengguna hanya boleh memuatkan data dari kedai dan melatih model. Latihan model boleh mengambil beberapa lelaran kerana setiap lelaran menjadikan model lebih berkesan dan bertambah baik.

Untuk mempelajari proses melaksanakan logik ReAct untuk bekerja dengan stor dokumen dalam LangChain, cuma ikut panduan mudah ini:

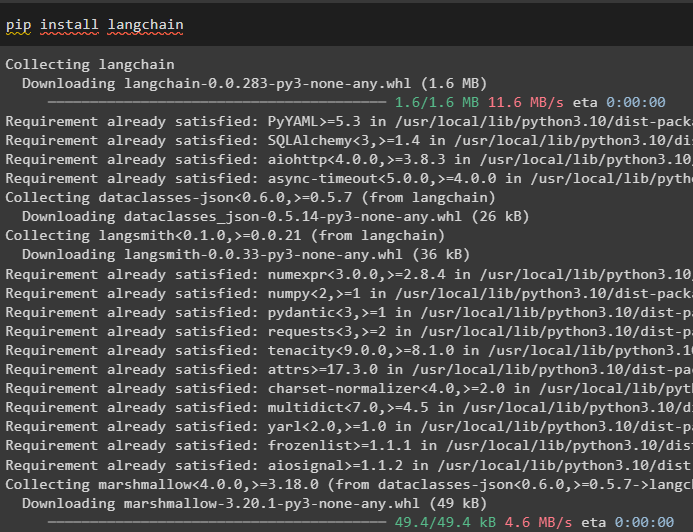

Langkah 1: Memasang Rangka Kerja

Mula-mula, mulakan dengan proses melaksanakan logik ReAct untuk bekerja dengan stor dokumen dengan memasang rangka kerja LangChain. Memasang rangka kerja LangChain akan mendapat semua kebergantungan yang diperlukan untuk mendapatkan atau mengimport perpustakaan untuk melengkapkan proses:

pip pasang langchain

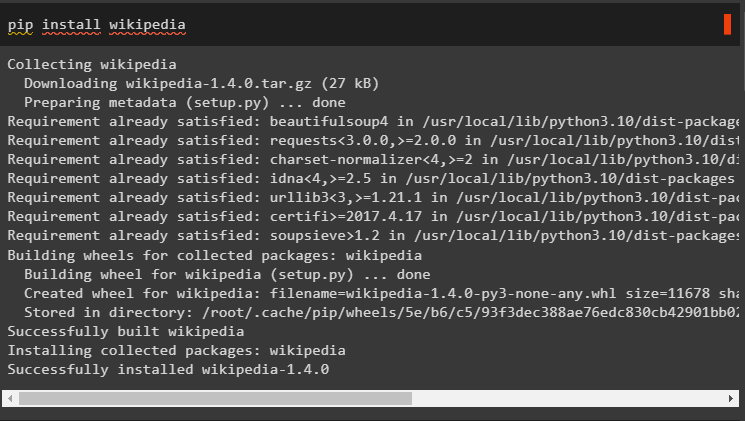

Pasang kebergantungan Wikipedia untuk panduan ini kerana ia boleh digunakan untuk membolehkan stor dokumen berfungsi dengan logik ReAct:

pip pasang wikipedia

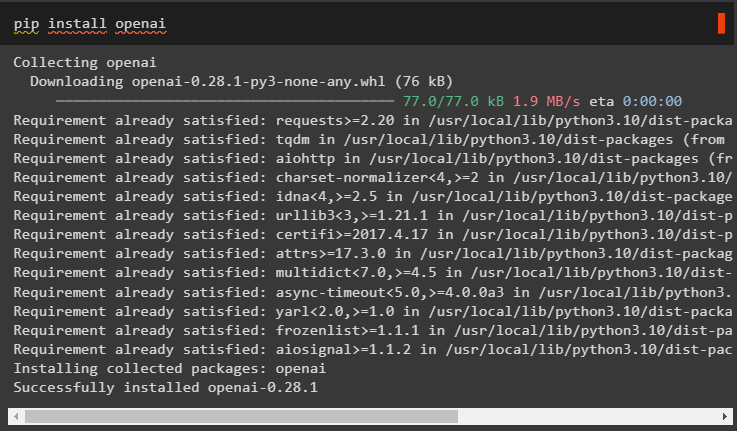

Pasang modul OpenAI menggunakan arahan pip untuk mendapatkan perpustakaannya dan membina Model Bahasa Besar atau LLM:

pip pasang openai

Langkah 2: Menyediakan Kunci API OpenAI

Selepas memasang semua modul yang diperlukan, hanya menetapkan persekitaran menggunakan kunci API daripada akaun OpenAI menggunakan kod berikut:

import awakimport getpass

awak . lebih kurang [ 'OPENAI_API_KEY' ] = getpass . getpass ( 'OpenAI API Key:' )

Langkah 3: Mengimport Perpustakaan

Setelah persekitaran disediakan, import perpustakaan daripada LangChain yang diperlukan untuk mengkonfigurasi logik ReAct untuk bekerja dengan stor dokumen. Menggunakan ejen LangChain untuk mendapatkan DocstoreExplaorer dan ejen dengan jenisnya untuk mengkonfigurasi model bahasa:

daripada langchain. llms import OpenAIdaripada langchain. kedai doktor import Wikipedia

daripada langchain. ejen import initialize_agent , alat

daripada langchain. ejen import Jenis Agen

daripada langchain. ejen . bertindak . asas import DocstoreExplorer

Langkah 4: Menggunakan Wikipedia Explorer

Konfigurasikan ' kedai doktor ” pembolehubah dengan kaedah DocstoreExplorer() dan panggil kaedah Wikipedia() dalam hujahnya. Bina Model Bahasa Besar menggunakan kaedah OpenAI dengan “ teks-davinci-002 ” model selepas menetapkan alat untuk ejen:

kedai doktor = DocstoreExplorer ( Wikipedia ( ) )alatan = [

alat (

nama = 'Cari' ,

fungsi = kedai doktor. cari ,

penerangan = 'Ia digunakan untuk bertanya pertanyaan/gesaan dengan carian' ,

) ,

alat (

nama = 'Cari' ,

fungsi = kedai doktor. carian ,

penerangan = 'Ia digunakan untuk bertanya pertanyaan/gesaan dengan carian' ,

) ,

]

llm = OpenAI ( suhu = 0 , nama model = 'teks-davinci-002' )

#mendefinisikan pembolehubah dengan mengkonfigurasi model dengan ejen

bertindak = initialize_agent ( alatan , llm , ejen = Jenis Agen. REACT_DOCSTORE , bertele-tele = betul )

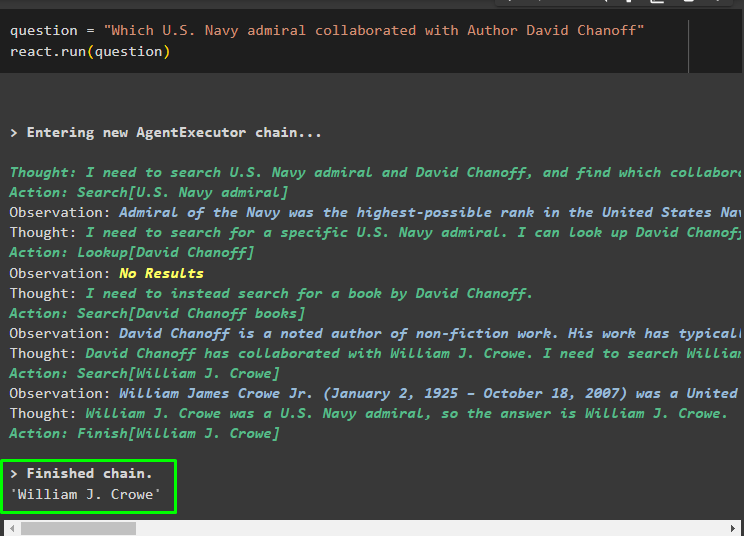

Langkah 5: Menguji Model

Setelah model dibina dan dikonfigurasikan, tetapkan rentetan soalan dan jalankan kaedah dengan pembolehubah soalan dalam hujahnya:

soalan = 'Laksamana Tentera Laut A.S. yang bekerjasama dengan Pengarang David Chanoff'bertindak. lari ( soalan )

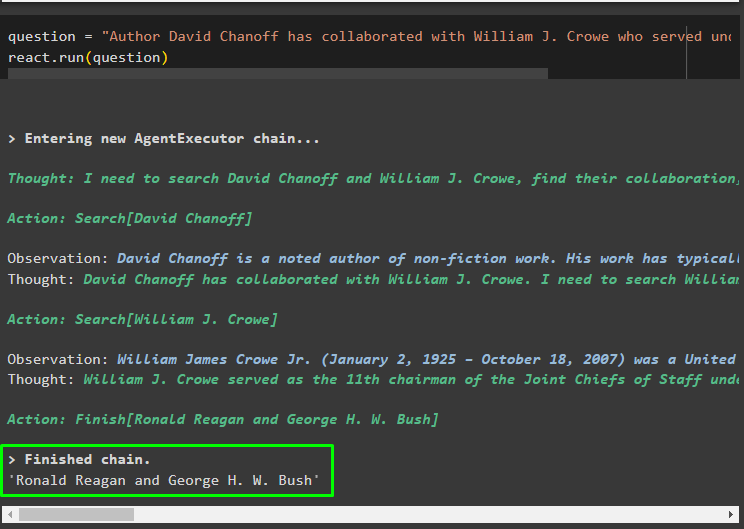

Setelah pembolehubah soalan dilaksanakan, model telah memahami soalan tanpa sebarang templat atau latihan gesaan luaran. Model sedang dilatih secara automatik menggunakan model yang dimuat naik dalam langkah sebelumnya dan menjana teks dengan sewajarnya. Logik ReAct bekerja dengan stor dokumen untuk mengekstrak maklumat berdasarkan soalan:

Tanya soalan lain daripada data yang diberikan kepada model daripada stor dokumen dan model akan mengekstrak jawapan daripada kedai:

soalan = 'Pengarang David Chanoff telah bekerjasama dengan William J Crowe yang berkhidmat di bawah Presiden mana?'bertindak. lari ( soalan )

Itu sahaja tentang melaksanakan logik ReAct untuk bekerja dengan stor dokumen di LangChain.

Kesimpulan

Untuk melaksanakan logik ReAct untuk kerja dengan stor dokumen dalam LangChain, pasang modul atau rangka kerja untuk membina model bahasa. Selepas itu, sediakan persekitaran untuk OpenAI untuk mengkonfigurasi LLM dan memuatkan model dari stor dokumen untuk melaksanakan logik ReAct. Panduan ini telah menghuraikan tentang melaksanakan logik ReAct untuk bekerja dengan stor dokumen.