Panduan ini akan menggambarkan proses menjalankan LLMChains dalam LangChain.

Bagaimana untuk Menjalankan LLMChains di LangChain?

LangChain menyediakan ciri atau kebergantungan untuk membina LLMChains menggunakan LLM/Chatbots dan templat segera. Untuk mempelajari proses membina dan menjalankan LLMChains dalam LangChain, cuma ikuti panduan langkah demi langkah berikut:

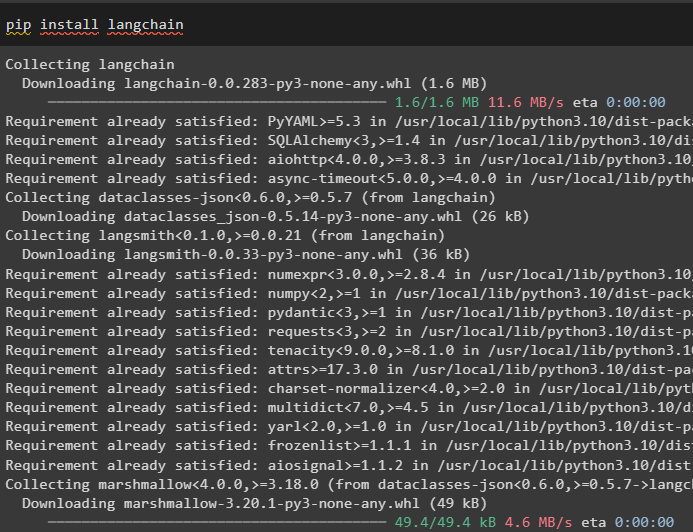

Langkah 1: Pasang Pakej

Mula-mula, mulakan proses dengan memasang modul LangChain untuk mendapatkan kebergantungannya untuk membina dan menjalankan LLMChains:

pip pasang langchain

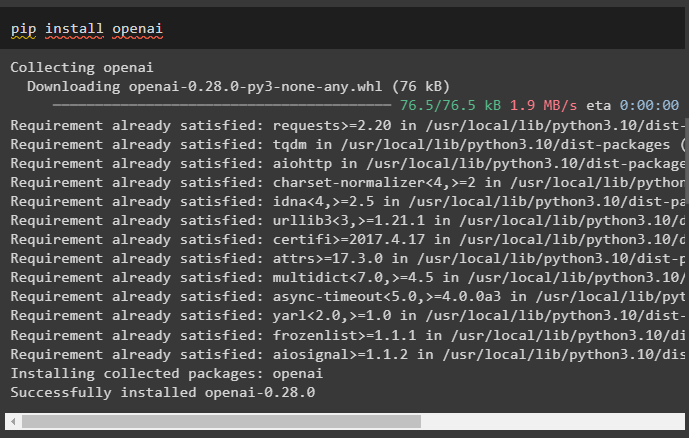

Pasang rangka kerja OpenAI menggunakan arahan pip untuk mendapatkan perpustakaan menggunakan fungsi OpenAI() untuk membina LLM:

pip pasang openai

Selepas pemasangan modul, hanya menetapkan persekitaran pembolehubah menggunakan kunci API daripada akaun OpenAI:

import awak

import getpass

awak . lebih kurang [ 'OPENAI_API_KEY' ] = getpass . getpass ( 'OpenAI API Key:' )

Langkah 2: Import Perpustakaan

Setelah persediaan selesai dan semua pakej yang diperlukan dipasang, import perpustakaan yang diperlukan untuk membina templat segera. Selepas itu, cukup bina LLM menggunakan kaedah OpenAI() dan konfigurasikan LLMChain menggunakan templat LLM dan gesaan:

daripada langchain import PromptTemplatedaripada langchain import OpenAI

daripada langchain import LLMChain

prompt_template = 'berikan saya gelaran yang bagus untuk perniagaan yang menghasilkan {produk}?'

llm = OpenAI ( suhu = 0 )

llm_chain = LLMChain (

llm = llm ,

segera = PromptTemplate. from_template ( prompt_template )

)

llm_chain ( 'pakaian berwarna-warni' )

Langkah 3: Rantaian Larian

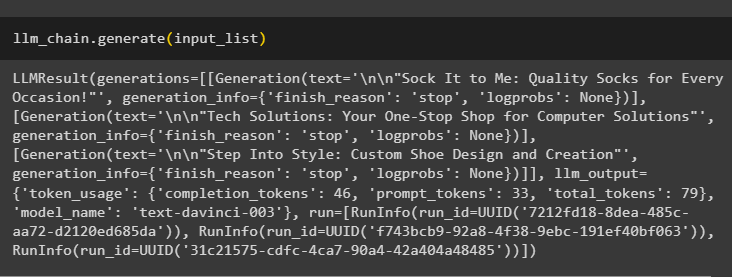

Dapatkan senarai input yang mengandungi pelbagai produk yang dihasilkan oleh perniagaan dan jalankan rantaian untuk memaparkan senarai pada skrin:

senarai_input = [{ 'produk' : 'stoking' } ,

{ 'produk' : 'komputer' } ,

{ 'produk' : 'kasut' }

]

llm_chain. memohon ( senarai_input )

Jalankan kaedah generate() menggunakan senarai_input dengan LLMChains untuk mendapatkan output yang berkaitan dengan perbualan yang dihasilkan oleh model:

llm_chain. menjana ( senarai_input )

Langkah 4: Menggunakan Input Tunggal

Tambah produk lain untuk menjalankan LLMChains dengan hanya menggunakan satu input dan kemudian meramalkan LLMChain untuk menjana output:

llm_chain. menjangkakan ( produk = 'stokin berwarna-warni' )Langkah 5: Menggunakan Berbilang Input

Sekarang, bina templat untuk menggunakan berbilang input untuk menyediakan arahan kepada model sebelum menjalankan rantai:

templat = ''' Beritahu saya jenaka {kata sifat} tentang {subjek}.'''segera = PromptTemplate ( templat = templat , input_variables = [ 'kata sifat' , 'subjek' ] )

llm_chain = LLMChain ( segera = segera , llm = OpenAI ( suhu = 0 ) )

llm_chain. menjangkakan ( kata sifat = 'sedih' , subjek = 'itik' )

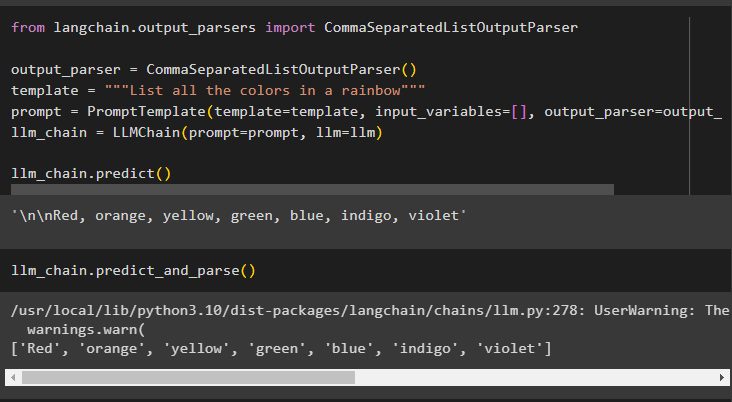

Langkah 6: Menggunakan Penghurai Output

Langkah ini menggunakan kaedah penghurai output untuk menjalankan LLMChain untuk mendapatkan output berdasarkan gesaan:

daripada langchain. output_parser import CommaSeparatedListOutputParseroutput_parser = CommaSeparatedListOutputParser ( )

templat = '''Senaraikan semua warna dalam pelangi'''

segera = PromptTemplate ( templat = templat , input_variables = [ ] , output_parser = output_parser )

llm_chain = LLMChain ( segera = segera , llm = llm )

llm_chain. menjangkakan ( )

Menggunakan kaedah parse() untuk mendapatkan output akan menghasilkan senarai yang dipisahkan koma bagi semua warna dalam pelangi:

llm_chain. predict_and_parse ( )

Langkah 7: Memulakan Daripada Rentetan

Langkah ini menerangkan proses menggunakan rentetan sebagai gesaan untuk menjalankan LLMChain menggunakan model dan templat LLM:

templat = ''' Beritahu saya jenaka {kata sifat} tentang {subjek}'''llm_chain = LLMChain. from_string ( llm = llm , templat = templat )

Sediakan nilai pembolehubah dalam gesaan rentetan untuk mendapatkan output daripada model dengan menjalankan LLMChain:

llm_chain. menjangkakan ( kata sifat = 'sedih' , subjek = 'itik' )Itu semua tentang menjalankan LLMChains menggunakan rangka kerja LangChain.

Kesimpulan

Untuk membina dan menjalankan LLMChains dalam LangChain, pasang prasyarat seperti pakej dan sediakan persekitaran menggunakan kunci API OpenAI. Selepas itu, import perpustakaan yang diperlukan untuk mengkonfigurasi templat dan model segera untuk menjalankan LLMChain menggunakan kebergantungan LangChain. Pengguna boleh menggunakan penghurai output dan arahan rentetan untuk menjalankan LLMChains seperti yang ditunjukkan dalam panduan. Panduan ini telah menghuraikan proses lengkap menjalankan LLMChains dalam LangChain.